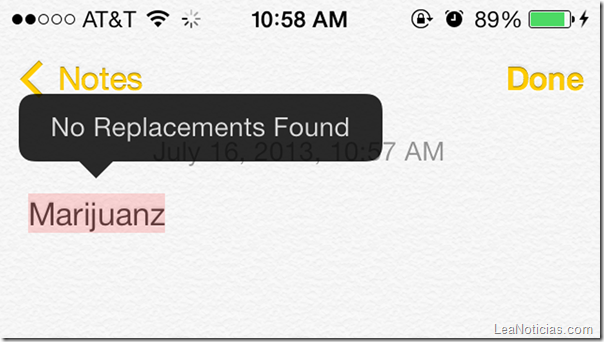

Si utilizas un iPhone o un iPad con iOS 6, este es el pan de cada día: escribes una palabra mal, se resalta en rojo, tocas la palabra y el software te ofrece alternativas. Sin embargo, si lo que acabas de escribir es una palabra «delicada» como «aborto», «marihuana» o «violación», el sistema no te ofrecerá correcciones posibles. Según un análisis de The Daily Beast, eso es exactamente lo que ocurre: hay una lista de palabras que, al deletrearlas mal por una letra, el sistema no querrá (o sabrá) darte una alternativa. Al menos en inglés. ¿Censura indirecta de Apple o simple fallo técnico?

Puedes ver el análisis completo de The Daily Beast por aquí. Para comprobarlo, incluso crearon un software con el que testear automáticamente el corrector de palabras. Su conclusión: existe una lista de decenas de palabras como bigot (fanático) cuckold (cornudo), marijuana, pornography, prostitute y suicide, para las que iOS simplemente no ofrece alternativa.

Además de los «delicados», hay otros términos para las que tampoco hay corrección sugerida al escribirlos mal, aunque por otro motivo: son muy técnicos o escasamente utilizados. Sin embargo, parece lógico que palabras en inglés tan comunes como pornografía, suicido o prostituta, vengan de fábrica con la opción correcta sugerida. Tal vez Apple piensa diferente.

Lo curioso es que en versiones anteriores a iOS 6 el sistema sí sugería la palabra correcta para muchos de esos términos delicados. Ahora, Apple parece haber cambiado de opinión al respecto. O tal vez se trata solo de un fallo del software. Difícil saberlo: la compañía ha rechazado comentar el asunto con The Daily Beast.

¿Censura indirecta deliberada por parte de Apple? ¿Despiste en el desarrollo del software? Hay que decir que el análisis de The Daily Beast se ha hecho con iPhones sin ningún historial de uso, tal cual como venían de fábrica. El sistema aprende poco a poco cuáles son las palabras más usadas y, en teoría, las va incorporando. Es decir, si utilizas mucho «suicidio» o «pornografía», al final debería mostrar la sugerencia correcta si las deletreas mal. Y también puedes añadirlas directamente al diccionario para que lo haga. Sin embargo, que no vengan incluidas de fábrica en el diccionario o en el autocorrector es, cuando menos, sospechoso.

Fuente: es.gizmodo.com